华夏天信集团作为能源行业工业物联网技术的引领者,其研发能力不仅直接惠及产业发展,更是开枝散叶应用到生产之外的日常管理中,通过AI视觉分析技术,最大限度地降低人的不安全因素。

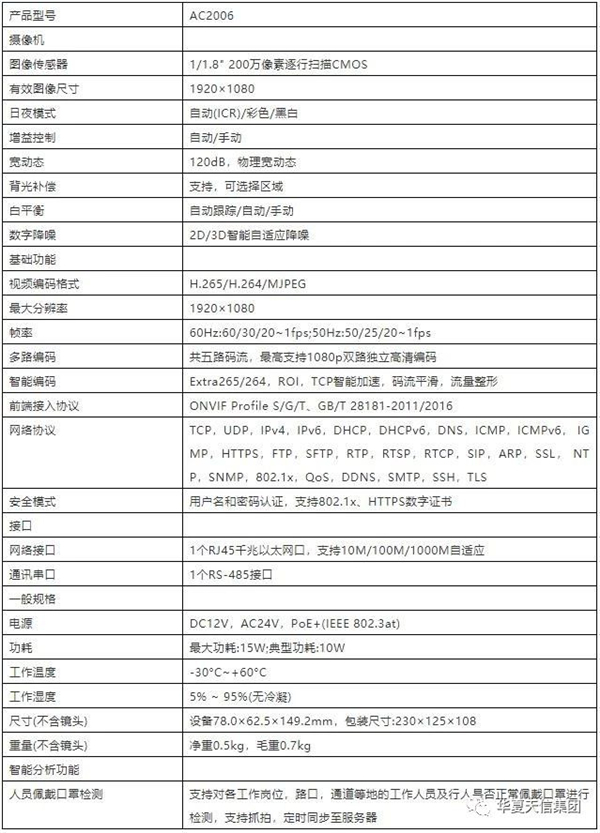

日前,华夏天信集团工程技术人员研发出口罩佩戴检测技术,该技术基于人工智能视觉分析技术,支持对各类工作岗位及路口、通道等场所的工作人员及行人是否正常佩戴口罩进行检测。可以有效监测工作人员佩戴口罩情况,监测到人员未佩戴口罩进行报警,有效的保障工作场所安全卫生情况,减少人力监管成本。

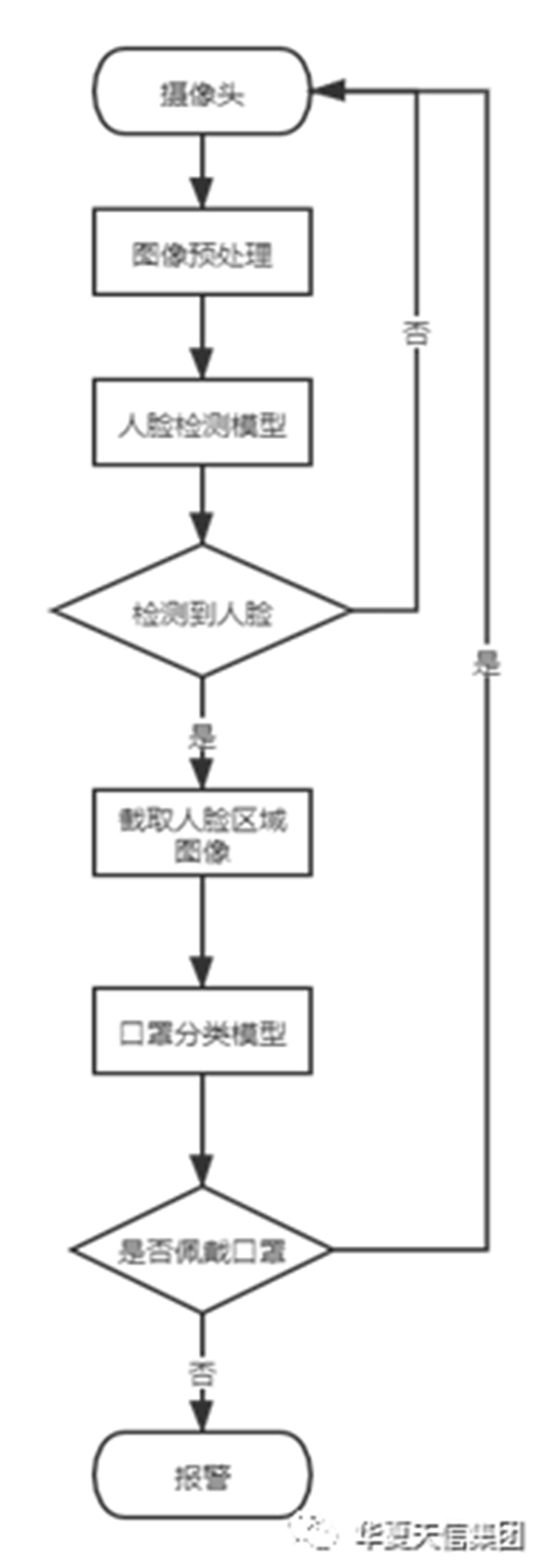

口罩佩戴检测需要检测到人脸并判断是否佩戴口罩,是一个目标检测及图像分类问题。通过主流目标检测模型进行迁移学习训练得到人脸检测模型。

主流的目标检测模型有以RCNN,SPP-Net,Fast-RCNN,Faster-RCNN,Mask-RCNN等为代表的两阶段模型,以YOLO系列,SSD,RetinaNet为代表的一阶段模型。

Faster-RCNN是一种典型的两阶段模型,由Fast-RCNN改进而来,两者主要的不同在于感兴趣区域的生成方法,Fast-RCNN使用的是启发式方法选择性搜索,而Faster-RCNN用的是区域候选网络(RPN),RPN将图像特征映射作为输入,生成一系列的候选区域检测框,每个都带有相应的分数。Faster-RCNN的大致过程如下:首先,输入图像到卷积网络中,生成该图像的特征映射。其次,在特征映射上应用区域候选网络,并返回候选区域检测框和相应分数。然后,应用感兴趣区域池化层(ROI Pooling),将所有候选框修正到同样的尺寸,最后将候选框传递到完全连接层,生成目标物体的边界框。Faster-RCNN较Fast-RCNN在速度上有了大幅提升,并且精确性也更好。

YOLO模型将目标检测形式转化为回归问题,从整张图像直接回归类别概率和检测框进行端到端训练。YOLO首先将图片重整到固定尺寸,通过卷积神经网络提取特征图,将特征图片划分成SxS的网格,然后对每个网络进行分类,并使用非极大抑制算法(NMS)去除重叠框,最终输出边界框信息以及目标物体置信度。通过这种方式,YOLO可实现45帧每秒的运算速度,完全满足实时性要求。

图像分类是计算机视觉中最基础的一个任务,它的目标是将不同的图像,划分到不同的类别,实现最小的分类误差。图像分类模型伴随着数据集的增长,一步一步提升到了超过人类的水平。经典的图像分类模型有VGGNet,GoogleNet,ResNet,Inception,DenseNet,以及适用于移动端的MobilieNet系列等。

华夏天信技术路线:

电话、微信:13521200337\13021034858 邮箱:chinabiot@163.com

|